Следующее поколение чат-ботов с искусственным интеллектом и генераторов картинок будет выдавать свои результаты быстрее. Ускорение их работы стало возможно благодаря новой видеокарте Nvidia HGX H200 Tensor Core. Она использует архитектуру Hopper и демонстрирует сверхвысокую производительность.

Новый графический процессор – это продолжение графического процессора H100, выпущенного в прошлом году и ранее мощного графического процессора Nvidia для искусственного интеллекта.

По мнению экспертов, недостаточная вычислительная мощность являлась основным препятствием прогрессу искусственного интеллекта в прошлом году, мешая развертыванию существующих моделей искусственного интеллекта и замедляя разработку новых.

Несмотря на название графических процессоров, эти предназначенные для центров обработки данных чипы обычно не предназначены для работы с графикой. Графические процессоры идеально подходят для приложений искусственного интеллекта, поскольку они выполняют множество параллельных умножений матриц, необходимых для функционирования нейронных сетей. Они важны в учебной части построения модели искусственного интеллекта и части вывода – когда люди вводят данные в модель искусственного интеллекта, и она возвращает результаты.

Например, OpenAI неоднократно заявлял, что у него мало ресурсов GPU, и это влечет замедление работы с ChatGPT. Чтобы предоставлять любые услуги, компания должна вводить ограничения. Гипотетически использование H200 может дать существующим языковым моделям искусственного интеллекта, которые запускают ChatGPT больше пространства для обслуживания большего количества клиентов.

По словам Nvidia, H200 является первым GPU, предлагающим память HBM3e. Благодаря HBM3e чип H200 предлагает 141 ГБ памяти и пропускную способность 4,8 терабайта в секунду, что, по словам Nvidia, в 2,4 раза превышает пропускную способность памяти Nvidia A100, выпущенного в 2020 году. Несмотря на возраст A100, он все еще пользуется высоким спросом из-за дефицита других чипов.

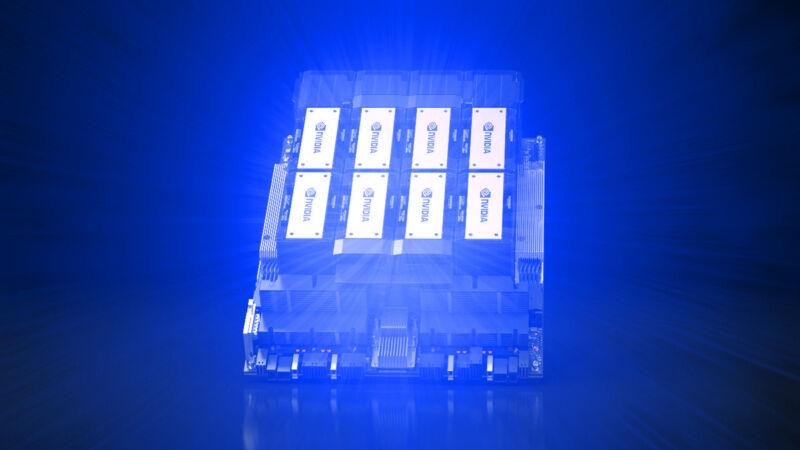

Nvidia выпустит H200 в нескольких форм-факторах. Сюда входят серверные платы Nvidia HGX H200 в четырех- и восьмиканальных конфигурациях, совместимые с аппаратным и программным обеспечением систем HGX H100. Он также будет доступен в суперчипе Nvidia GH200 Grace Hopper, объединяющем центральный и графический процессоры в одном пакете для еще большего развития искусственного интеллекта.

Amazon Web Services, Google Cloud, Microsoft Azure и Oracle Cloud Infrastructure станут первыми поставщиками облачных услуг, которые будут развертывать экземпляры на основе H200, начиная со следующего года, и Nvidia говорит, что H200 будет доступен у глобальных производителей систем и поставщиков облачных услуг во 2 квартале 2024 года.