НА ПРАВАХ РЕКЛАМЫ

Архитектура цифрового превосходства…

Представьте себе, что вы решили открыть собственный ресторан. На первых порах, пока вы проверяете концепцию и готовите для небольшого круга постоянных гостей, вам вполне достаточно арендовать место на ресторанном маркете или делить кухню с другим небольшим производством. Это выгодно, снижает ваши первоначальные затраты, но наступает момент, когда бизнес начинает расти. Появляются очереди, меню расширяется, и вот вы уже сталкиваетесь с тем, что соседние повара занимают ваши плиты, а мощности общей электросети не хватает для одновременного включения всех духовок. В этот момент вы понимаете: чтобы двигаться дальше и обслуживать сотни гостей без задержек, вам необходимо полностью отдельное здание, где каждая деталь принадлежит только вам.

В мире интернет-технологий происходит абсолютно то же самое. Когда ваш сайт, приложение или база данных перерастают рамки стандартного виртуального хостинга и даже гибкого VDS, вам требуется бескомпромиссная независимость. Именно эту задачу решает услуга, подробно описанная на странице аренды выделенных серверов компании DeltaHost — предоставление в ваше полное и единоличное распоряжение отдельного физического компьютера в современном дата-центре. В этой статье мы подробно разберем, как устроен этот сегмент, в каких жизненных ситуациях он становится спасением для бизнеса и на какие параметры нужно обращать внимание.

Азбука серверных технологий: Разбираем базовые термины

Прежде чем мы погрузимся в тонкости выбора конфигураций, давайте вместе разберем ключевые понятия, чтобы вы чувствовали себя уверенно в разговоре с любым техническим специалистом. Сфера ИТ наполнена аббревиатурами, но за ними скрываются вполне логичные и понятные вещи.

- Выделенный сервер (Dedicated Server): Это реальный, физический компьютер (системный блок специальной серверной формы), который устанавливается в технологическую стойку внутри охраняемого дата-центра. В отличие от виртуального хостинга, здесь нет никаких «соседей». Все диски, процессоры и сетевые каналы работают исключительно на ваши задачи.

- IPMI (Intelligent Platform Management Interface): Представьте, что у вас есть возможность виртуально подойти к компьютеру, который находится на другом конце планеты, нажать на нем кнопку включения, вставить флешку или зайти в BIOS, даже если сама операционная система полностью «зависла». IPMI — это независимый чип управления, дающий вам стопроцентный удаленный контроль над «железом» в режиме 24/7.

- Трафик и скорость порта: Порт — это ширина сетевого интернет-канала, ведущего к вашему серверу (например, 1 Гбит/с можно сравнить с широким многополосным шоссе), а трафик — это объем данных, который ваши пользователи скачивают и загружают через это «шоссе» за месяц.

Если проводить сравнение, то виртуальный хостинг — это место в многоместном номере хостела, VDS — это отдельная изолированная квартира в многоэтажном доме, а услуга, для которой на международном рынке используются термины server for rent или rent dedicated server — это владение роскошным частным особняком, где вы вольны перестраивать стены и менять планировку по собственному усмотрению.

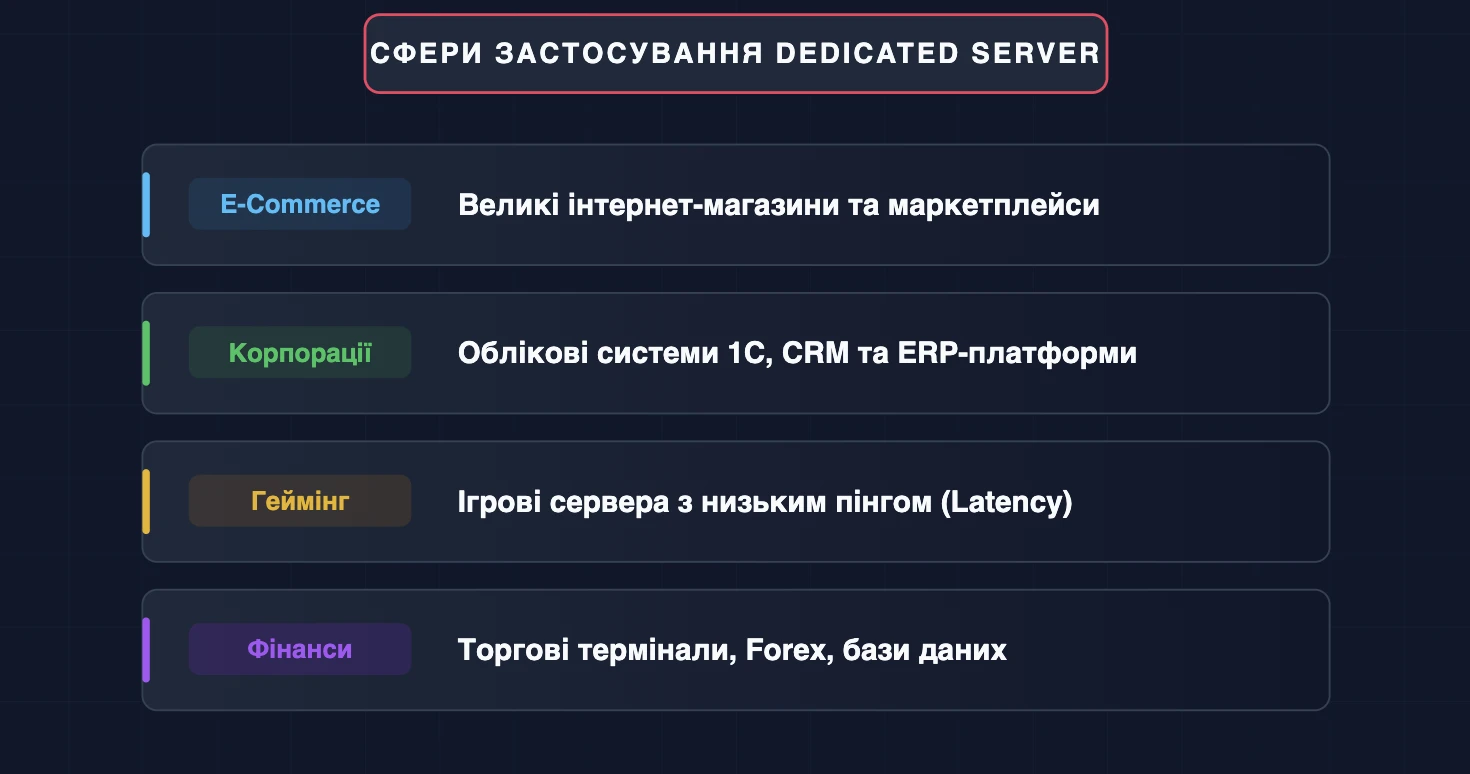

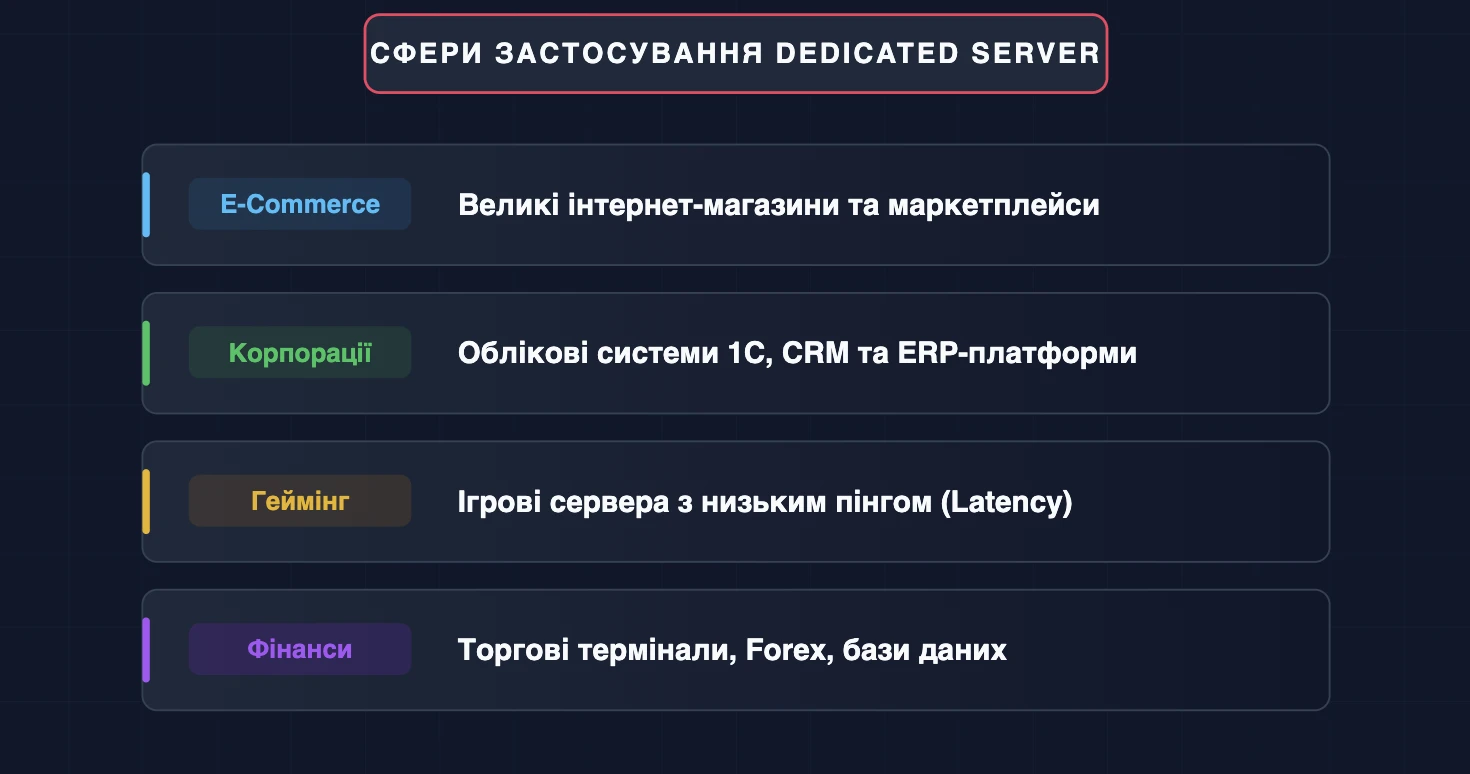

Современные сценарии применения: Когда пора переезжать на выделенное железо

Давайте рассмотрим реальную жизненную ситуацию, с которой сталкиваются многие успешные предприниматели. Представим, что вы владеете крупной сетью розничных магазинов и вся ваша бухгалтерия, учет товаров на складах и CRM-система для менеджеров работают через единую онлайн-платформу. В начале рабочего дня сотни сотрудников одновременно заходят в систему, проводят чеки, обновляют остатки товаров и загружают накладные.

Если вся эта критически важная инфраструктура будет размещена на общем сервере, то малейший сбой из-за внешних факторов парализует работу всей сети. Потери от простоя в течение всего одного часа могут исчисляться огромными суммами. Именно для защиты от подобных рисков крупные корпоративные клиенты выбирают аренду физического оборудования. Выделенная платформа гарантирует стабильное и предсказуемое время отклика системы, поскольку внешние интернет-штормы или чужие сайты никак не могут повлиять на ваши изолированные ресурсы.

Давайте сопоставим поведение разных типов хостинга в реальных рабочих условиях:

- Обработка баз данных: На виртуальном сервере скорость чтения и записи на диск зависит от активности других клиентов. На выделенном физическом сервере вся дисковая подсистема выполняет только ваши запросы, что ускоряет генерацию тяжелых отчетов в разы.

- Масштабируемость и безопасность: Любое виртуальное окружение имеет программные лимиты со стороны гипервизора. Физический сервер позволяет задействовать инструкции процессора напрямую, обеспечивая максимальный уровень криптографической защиты ваших коммерческих данных.

Технические параметры простым языком: На что влияют ядра и память?

Когда вы открываете список доступных конфигураций, перед вами появляется таблица с техническими характеристиками. Чтобы помочь вам сделать осознанный выбор и не переплачивать, давайте просто и понятно разберем, за что отвечает каждый узел.

Количество ядер процессора (CPU Cores)

Процессор — это мозг машины, а его ядра — это количество «сотрудников», которые одновременно выполняют задачи. Представим кассу в супермаркете. Если у вас 4-ядерный процессор, это означает, что в вашем магазине работают четыре кассира. Они быстро обслужат поток покупателей. Но если к вам одновременно придут тысячи клиентов (например, во время проведения крупной онлайн-распродажи), четырех человек станет недостаточно, и возникнет очередь (задержка загрузки страниц). Для тяжелых сайтов, обработки видео или игровых платформ выбирают процессоры с 8, 16 или даже 32 ядрами, что эквивалентно открытию огромного гипермаркета с десятками касс.

Оперативная память (RAM)

Если процессор — это кассир, то оперативная память — это размер его рабочего стола. Чем больше у кассира стол, тем больше документов, товаров и заказов он может разложить перед собой для одновременной обработки, не упаковывая их каждый раз обратно на склад (на медленный жесткий диск). Если оперативной памяти мало (например, всего 8 или 16 ГБ для нагруженного проекта), сервер будет постоянно обращаться к дисковой памяти, что мгновенно замедлит работу всей системы. Современные конфигурации бизнес-класса предлагают от 32 до 512 ГБ оперативной памяти, позволяя удерживать все активные процессы в сверхбыстром доступе.

Дисковая архитектура (NVMe SSD)

Объем диска определяет, сколько терабайт информации вы можете сохранить. Но гораздо важнее его скорость. Использование современных накопителей NVMe вместо устаревших механических HDD — это как замена почтовой кареты на реактивный самолет. Продукты мгновенно отдаются пользователям, а базы данных обрабатывают тысячи поисковых запросов в секунду.

География, стоимость и условия аренды

Ценообразование на рынке аренды серверов прозрачно и напрямую привязано к двум факторам: мощности выбранного «железа» и географическому расположению дата-центра. Физическое расстояние от сервера до ваших конечных пользователей напрямую влияет на так называемый «пинг» — время, за которое сигнал долетает от компьютера клиента до сайта.

Если ваш бизнес ориентирован на международную аудиторию или американских партнеров, идеальным решением станет выбор услуги dedicated server usa. Размещение оборудования в дата-центрах США обеспечивает отличную связность с глобальными магистральными сетями. При этом стоимость аренды серверов начального уровня (например, надежные 4-ядерные конфигурации Intel Xeon с 32 ГБ RAM) начинается в среднем от $53 – $93 в месяц. Если же вам требуются мощные многопроцессорные системы с терабайтными хранилищами под бэкапы, стоимость может достигать $300 – $450 в месяц.

Давайте сравним географические особенности размещения:

- Локация США: Обеспечивает минимальный ping для пользователей из Северной Америки и идеальна для международных стартапов, но для пользователей из Восточной Европы задержка будет чуть выше.

- Локация Украина / Европа: Гарантирует молниеносную загрузку страниц для локального рынка, строгое соответствие региональным правилам защиты данных и оптимальную стоимость каналов связи.

Какие знания необходимы для управления сервером?

Вам может показаться, что управление собственным физическим сервером — это задача исключительно для сертифицированных ИТ-гуру. Доля правды в этом есть: базовый формат аренды (unmanaged) предполагает, что компания-провайдер предоставляет вам работающее «железо» и чистый доступ, а установку операционной системы, настройку веб-сервера (Nginx/Apache), защиту от сетевых атак и развертывание баз данных вы берете на себя. Для этого необходимы уверенные знания администрирования Linux/Windows систем и работы с командной строкой.

Однако прогресс не стоит на месте, и сегодня вам вовсе не обязательно нанимать дорогостоящего системного администратора в штат на полный день. Ведущие провайдеры, такие как DeltaHost, предлагают два отличных альтернативных пути для тех, кто хочет сосредоточиться исключительно на развитии своего бизнеса, а не на изучении серверных консолей:

- Бесплатные панели управления: При заказе вам могут бесплатно установить удобную панель (например, Hestia CP), которая превращает управление сервером в понятный визуальный интерфейс. Создать новый сайт, добавить почтовый ящик или настроить базу данных можно в несколько кликов мыши, как на обычном простом хостинге.

- Пакетное администрирование: Вы можете воспользоваться услугами штатных инженеров дата-центра. Любая сложная задача — от переноса сайта без прерывания его работы до тонкой настройки оптимизации под высокие нагрузки — может быть выполнена квалифицированными специалистами с оплатой за фактическое время работы (например, фиксированный тариф за каждые 15 минут работы администратора).

Заключение: Инвестиция в цифровую стабильность

Оценивая перспективы развития своего онлайн-бизнеса, ответьте себе на вопрос: готовы ли вы рисковать стабильностью проекта ради мнимой экономии на ресурсах? Переход на выделенные мощности — это не просто статья расходов, это стратегическое решение, которое выводит безопасность, скорость и авторитет вашей компании в цифровом пространстве на принципиально новый уровень.

Выбирайте конфигурацию с небольшим запасом на будущее, доверяйте инфраструктуру проверенным лидерам рынка с круглосуточной поддержкой и строгим SLA, и ваш сайт всегда будет радовать посетителей мгновенной работой в любых, даже самых нестандартных жизненных ситуациях.