Новий звіт показує, що для пошуку інформації в інтернеті краще використовувати класичні пошуковики, такі як Google чи Bing. Пошукові системи на базі інтелекту, які начебто шукають за вас, у більшості випадків не шукають, а вигадують інформацію. Дослідницький звіт від Columbia Journalism Review (CJR) показав, що моделі штучного інтелекту від таких компаній, як OpenAI і xAI, найчастіше, коли їх запитують про конкретну новинну подію, просто вигадують історію або спотворюють суттєві деталі.

Дослідники згодовували різним моделям прямі витяги з реальних новинних сюжетів, а потім просили штучні інтелекти вказати джерело інформації, включаючи заголовок статті, видавця та URL-адресу статті.

Perplexity повертав невірну інформацію в 37 відсотках випадків, у той час як Grok xAI змінював деталі в 97 відсотках випадків. Помилки включали в себе посилання на статті, які нікуди не вели, бо бот сам придумав URL статті.

У цілому, дослідники виявили, що моделі штучного інтелекту видавали неправдиву інформацію для 60 відсотків тестових запитів.

Іноді пошукові системи, такі як Perplexity, обходять платні брандмауери таких сайтів, як National Geographic, навіть якщо на цих сайтах встановлена інструкція, що забороняє сканування – класичні пошукові системи зазвичай поважають цю інструкцію.

У минулому компанія Perplexity не раз сварилася з-за цього, але стверджувала, що така практика є добросовісним використанням. Вона намагалася пропонувати угоди про розподіл доходів, щоб заспокоїти видавців, але як і раніше відмовляється припинити цю практику.

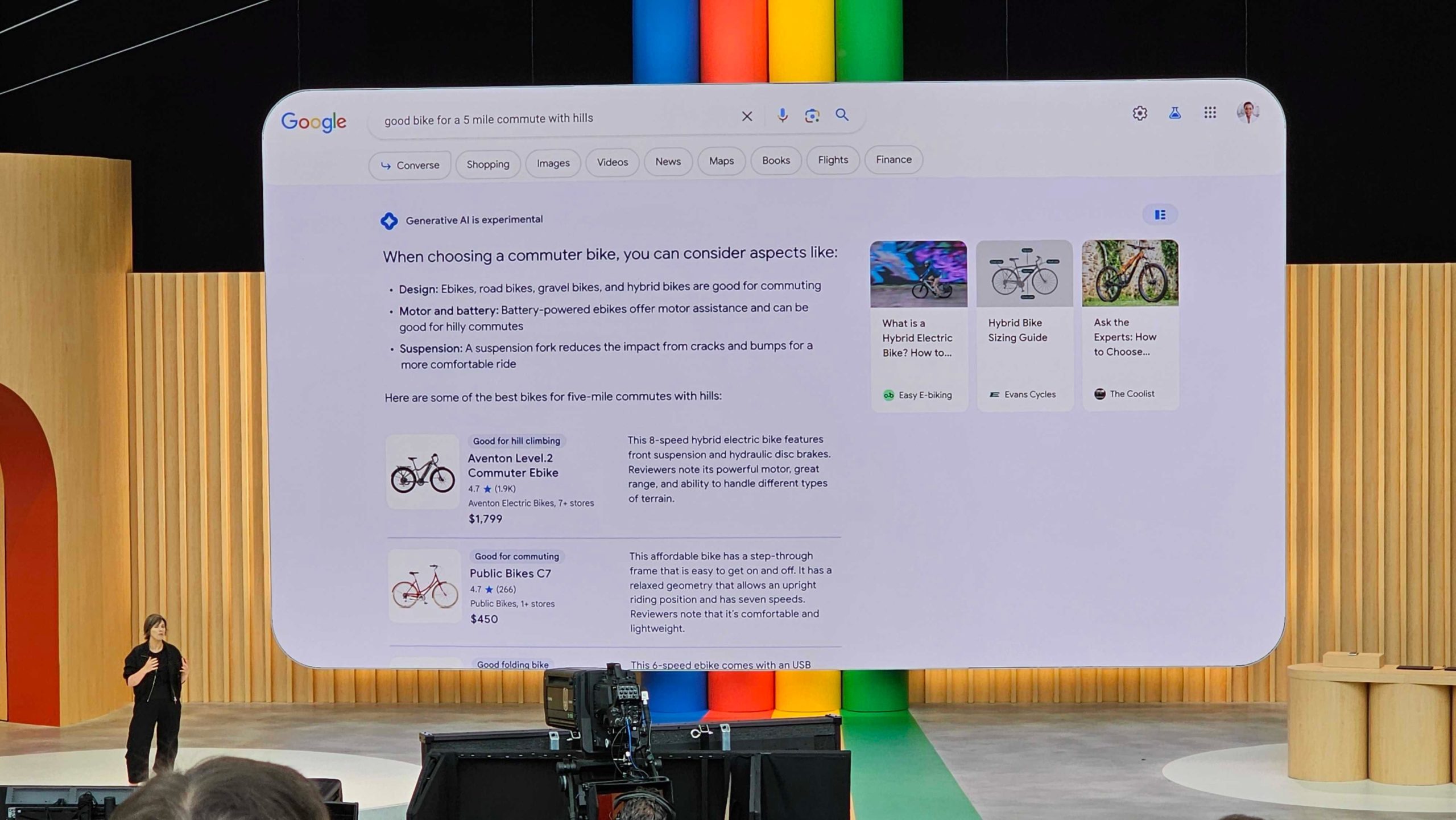

Кожен, хто користувався чат-ботами в останні роки, не повинен дивуватися. Чат-боти дають відповіді, навіть якщо їх ледве попрохати. Інтернет-пошук в чат-ботах включений за допомогою технології, званої генерацією з доповненим пошуком, яка переглядає інтернет у пошуках інформації по мірі отримання відповіді.

Одна з найнеприємніших речей, яку помітили деякі користувачі чат-ботів, полягає в тому, що, переглядаючи свій текст “міркувань” або логічний ланцюжок, яку чат-боти використовують для відповіді на запит, вони часто визнають, що вигадують. Наприклад, Claude з Anthropic спіймали на вставці даних-заповнювачів, коли його попросили провести дослідницьку роботу.

Марк Ховард, головний операційний директор журналу Time, присоромив користувачів, припустивши, що це їхня провина, якщо вони не скептично ставляться до точності безкоштовних інструментів штучного інтелекту: “Якщо хтось із споживачів прямо зараз вірить, що будь-який з цих безкоштовних продуктів буде точним на 100 відсотків, то ганьба їм”.

Очікування тут повинні бути мінімальними. Люди ледачі, а чат-боти відповідають на запити у впевненій манері, яка може приспати пильність користувачів. Настрої в соціальних мережах демонструють, що люди не хочуть переходити по посиланнях і воліють отримувати негайну відповідь від штучного інтелекту. І навіть до запуску інструментів генеративного штучного інтелекту більше половини пошукових запитів Google були “без кліка”, що означало, що користувач отримував необхідну йому інформацію, не переходячи на веб-сайт з інформацією. Інші сайти, такі як Вікіпедія, роками доводили, що люди візьмуть те, що може бути менш авторитетним, якщо воно буде безкоштовним та доступним.