Навіть якщо під час відеодзвінка ви на екрані бачите знайому людину, насправді це може бути шахрай. Обман за допомогою дипфейків уже став звичною справою: у червні кілька європейських мерів стали жертвою відеодзвінка фальшивого Віталія Кличка. А ФБР попередило, що шахраї використовують дипфейки під час співбесід на роботу. Поки що технології дипфейків не надто досконалі, тому є простий спосіб розпізнати, що ви розмовляєте по відео з шахраєм.

Якщо хочете переконатися у тому, що спілкуєтеся по відео з реальною людиною, а не з кимось іншим під маскою її обличчя – просто попросіть співрозмовника повернутися набік.

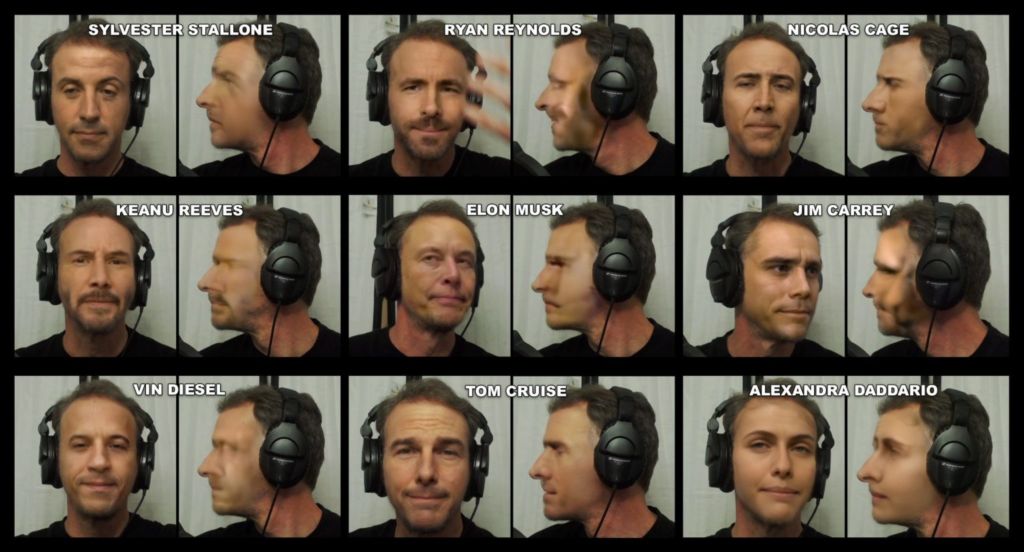

Цим трюком поділилися експерти лондонського стартапу Metaphysic.ai, який стоїть за вірусними дипфейками Тома Круза. Компанія використовувала DeepFaceLive – популярну програму для створення дипфейків, щоб перетворити волонтера на різних знаменитостей.

Більшість відтворень були вражаючими, коли волонтер дивився прямо вперед в об’єктив. Але як тільки він повернув голову на повні 90 градусів, зображення спотворилися, і глядачі бачили, що це – дипфейк.

Команда вважає, що дефекти виникли через недостатню кількість опорних точок для побудови віртуального обличчя дипфейку на реальному обличчі волонтера. При повороті голови волонтера алгоритм не може вгадати, як має виглядати.

Ці слабкі місця дипфейків можна зміцнити, але для цього потрібно багато працювати і мати багато фотографій. Звичайну людину рідко знімають на відео чи фотографують у профіль, тому алгоритм дипфейку не матиме достатньо даних для створення реалістичних бічних зображень.

Трюк з поворотом голови може перестати працювати в майбутньому з розвитком алгоритмів дипфейку. Майбутні 3D-системи можуть самі створювати переконливі види профілю.