Проста атака може призвести до того, що автопілот направить автомобіль на зустрічну смугу. Це довели дослідники лабораторії Tencent Keen Security Lab, які продемонстрували, як на ходу перехопити контроль над автопілотом Tesla. Як жертву обрали поліпшений автопілот Model S 75.

Поліпшений автопілот Tesla Enhanced Autopilot підтримує багато функцій, серед яких – вирівнювання у смузі, самостійне паркування, самостійна зміна смуги. Для своєї роботи він використовує камери, ультразвукові сенсори та радар, за допомогою яких збирає інформацію про об’єкти навколо, ландшафт тощо. Дані потім передаються до бортових комп’ютерів, які працюють на основі технологій нейромереж та машинного навчання для прийняття рішень у реальному часі.

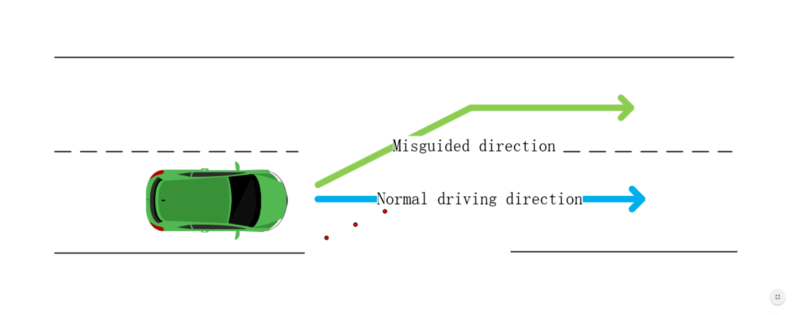

Дослідники з Tencent Keen Security Lab проаналізували, як реагує нейромережа автомобіля Tesla при зміні навколишніх параметрів. Вони відкрили, що є простий спосіб змусити електронний мозок виїхати на зустрічну смугу. Для цього необхідно на дорозі розмістити три невеликих наклейки. Для живих водіїв ці наклейки будуть ледь помітними, але електронний водій подумає, що поточна смуга відхиляється вліво. У результаті автопілот також направляє машину вліво.

«Автопілот Tesla має високу стійкість до зміни смуги в незвичайних навколишніх умовах – при слабкому світлі, дощі, снігу, пилу, – але вона досі некоректно опрацьовує наш тестовий сценарій, – кажуть експерти. – Цей тип атаки дуже легко втілити, матеріали є легкодоступними. Для прийняття рішення про зміну смуги автопілот Tesla використовує лише комп’ютерне бачення. Наші експерименти показали, що ця архітектура несе великі ризики».

Дослідники також змогли віддалено перехопити контроль над автопілотом Tesla, скориставшись вразливістю в його комп’ютері. Завдяки цьому вони змогли керувати автомобілем віддалено через джойстик. Ця діру закрили в прошивці Tesla 2018.24.