Дослідники з Microsoft представили штучний інтелект Kosmos-1. Це мультимодальна модель, яка може аналізувати вміст зображення, розв’язує візуальні головоломки, виконує візуальне розпізнавання тексту, проходить візуальні тести IQ і розуміє інструкції природною мовою. Дослідники вважають, що мультимодальний штучний інтелект, який об’єднує різні режими введення, такі як текст, аудіо, зображення та відео, є ключовим кроком до створення штучного загального інтелекту (AGI). AGI – це той тип штучного інтелекту, який працюватиме на рівні людського.

«Будучи базовою частиною інтелекту, багатомодальне сприйняття є необхідністю для досягнення загального штучного інтелекту з точки зору отримання знань і прив’язки до реального світу», — пишуть дослідники у своїй науковій статті «Мова — не все, що вам потрібно: узгодження сприйняття з мовними моделями».

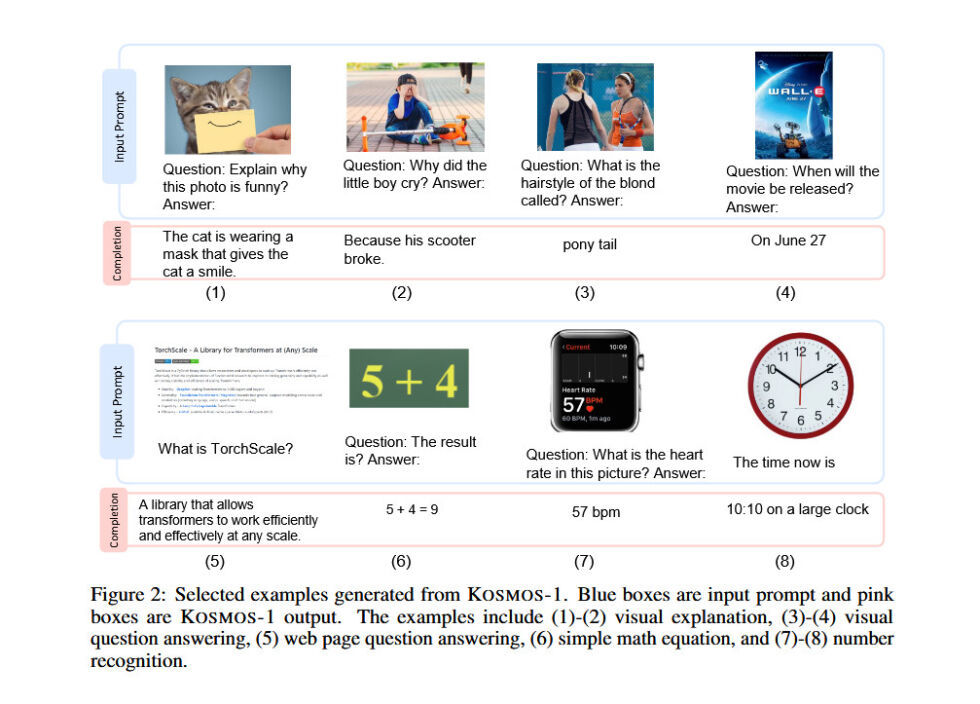

Візуальні приклади роботи Kosmos-1 показують, як модель аналізує зображення та відповідає на запитання про них, читає текст із зображення, пише підписи до зображень і виконує тест на візуальний IQ з точністю 22–26 відсотків.

Поки ЗМІ шумлять новинами про текстовий штучний інтелект, деякі експерти зі штучного інтелекту вказують на мультимодальний штучний інтелект як на потенційний шлях до загального штучного інтелекту (AGI) – гіпотетичної технології, яка нібито зможе замінити людей у будь-якому інтелектуальному завданні і будь-якій інтелектуальній роботі. AGI є заявленою метою OpenAI – ключового бізнес-партнера Microsoft у цій сфері.

У цьому випадку «Космос-1» виглядає суто проектом Microsoft, без участі OpenAI. Дослідники називають своє творіння «мультимодальною великою мовною моделлю» (MLLM), оскільки її коріння лежить у обробці природної мови, як-от ChatGPT використовується лише для тексту.

Щоб Космос-1 приймав вхідне зображення, дослідники повинні спочатку перевести зображення в спеціальну серію токенів (в основному текст), які може зрозуміти його велика мовна модель (LLM).

Корпорація Майкрософт навчала Kosmos-1, використовуючи дані з інтернету, включаючи уривки з The Pile (текстовий ресурс англійською мовою на 800 ГБ) і Common Crawl. Після навчання вони оцінили можливості Космосу-1 за кількома тестами, включаючи розуміння мови, створення мови, класифікацію тексту без оптичного розпізнавання символів, створення підписів до зображень, візуальні відповіді на запитання, відповіді на запитання на веб-сторінці та класифікацію зображень. За даними Microsoft, у багатьох із цих тестів Космос-1 перевершив поточні найсучасніші моделі.

Особливий інтерес представляє продуктивність Космосу-1 за програмою Raven’s Progressive Reasoning, яка вимірює візуальний IQ, представляючи послідовність фігур і просячи учасника завершити послідовність.

Щоб протестувати Космос-1, дослідники надали йому заповнений тест і запитали, чи правильна відповідь. Космос-1 зміг правильно відповісти на запитання тесту Raven лише у 22 відсотках випадків (26 відсотків із ретельнішим налаштуванням). Помилки в методології могли вплинути на результати, але Космос-1 перевершив випадкову ймовірність (17 відсотків) у тесті Raven IQ.

І все ж, незважаючи на те, що Kosmos-1 являє собою ранні кроки в мультимодальній сфері, легко уявити, що майбутня оптимізація може принести ще більш значущі результати, дозволяючи штучному інтелекту сприймати будь-які форми медіа та діяти з ними, що значно розширить здібності штучних помічників.

У майбутньому дослідники кажуть, що вони хотіли б збільшити розмір моделі Космос-1 і також інтегрувати можливість мовлення. Microsoft каже, що планує зробити Kosmos-1 доступним для розробників.