Дослідження Microsoft показує, наскільки погано ми розпізнаємо зображення штучного інтелекту. Новий дослідницький документ Microsoft AI for Good, в якому описаний експеримент, в якому взяли участь понад 12 500 осіб по всьому світу і було оцінено 287 000 зображень, показав, що загальний відсоток успіху розпізнавання ШІ як автора зображень, становив лише 62%. Це вказує на те, що люди володіють здатністю упізнавати фальшиві зображення на рівні, трои вищому випадковому вгадуванню.

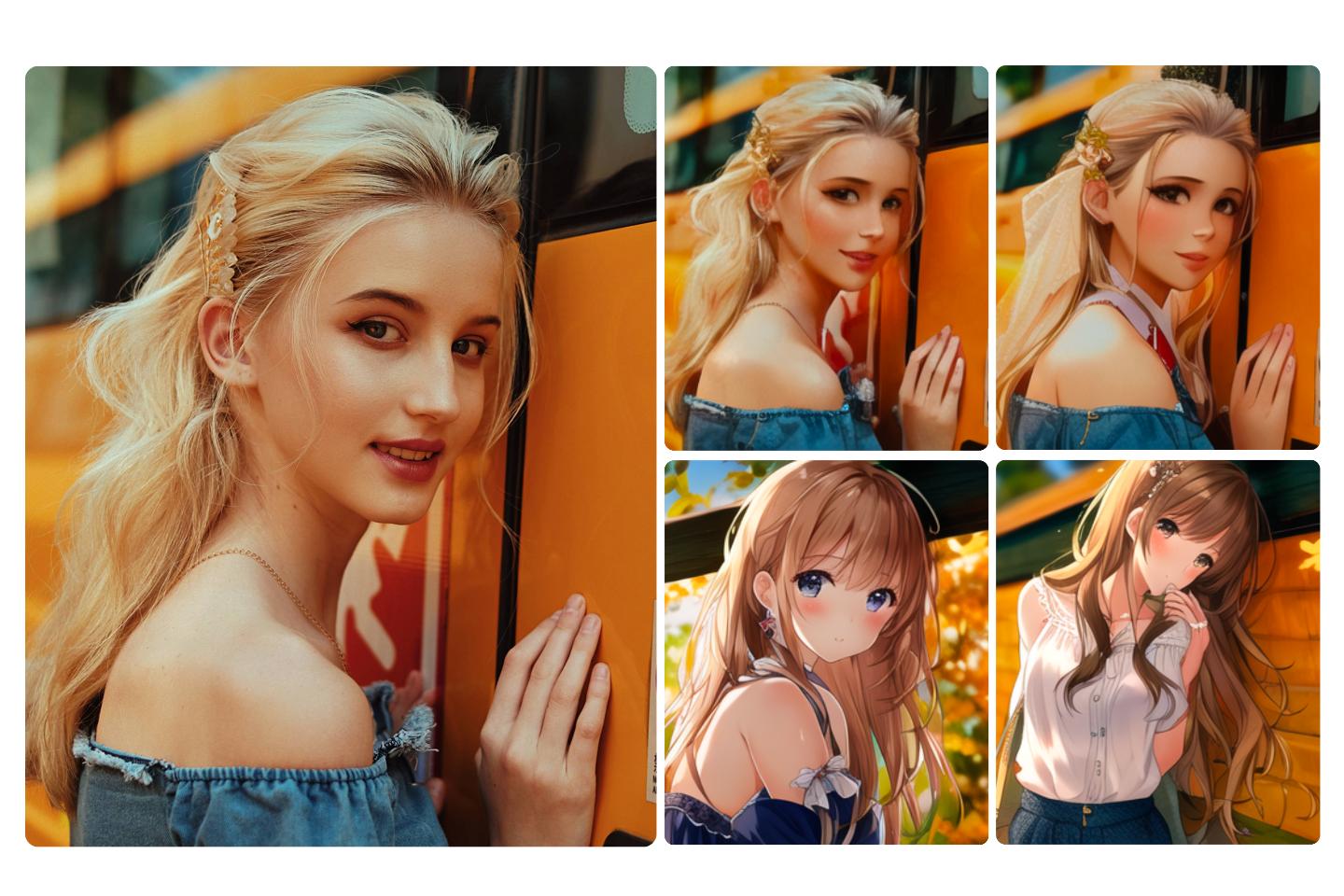

Було виявлено, що учасники з найбільшою легкістю визначали підроблені людські портрети, але відчували значні труднощі, коли справа доходила до природних і міських пейзажів, причому показники успіху знижувалися до 59-61%. Низькі бали підкреслюють проблеми, з якими стикаються люди при спробі розрізнити зображення штучного інтелекту, особливо ті, які не містять видимих артефактів або стилістичних натяків.

В ході дослідження учасникам належало зіграти в вікторину, в якій їм показували зображення штучного інтелекту, з якими вони, ймовірно, стикалися в інтернеті в реальності. Учасники дослідження уникали вибирати зображення, схожі на вишні, або вибирали тільки дуже оманливі зображення. Було також відзначено, що штучний інтелект постійно удосконалюється, тому майбутні моделі можуть створювати ще більш переконливі зображення.

Грунтуючись на результатах дослідження, Microsoft закликає використовувати інструменти прозорості, такі як водяні знаки, і надійні інструменти виявлення з допомогою штучного інтелекту, щоб усунути ризики дезінформації, що виникають з контенту, створеного штучним інтелектом. Щоб допомогти розповісти людям про ці небезпеки, редмондский гігант раніше запустив кампанію по боротьбі з дезінформацією, що генерується штучним інтелектом.

Дослідники також мали доступ до свого власного інструменту виявлення штучного інтелекту, і він зміг добитися успіху вище 95% як на реальних, так і на згенерованих штучним інтелектом зображеннях за категоріями. Це говорить про те, що машинна набагато надійніше людського судження виявляє фейковий контент, але навіть вона не ідеальна.

Також важливо відзначити, що навіть якщо у вас є видимий водяний знак на зображенні в кутку, зловмисники, які бажають обдурити людей з допомогою підроблених зображень, можуть легко обрізати або погіршити видимість водяного знака з допомогою елементарних інструментів.

Цікаво, що дослідження показало, що старі генеративні змагальні мережі (GAN) і техніки малювання були досить гарні для обману користувачів, оскільки вони створювали зображення, схожі на любительську фотографію, а не на студійну естетику, використовувану популярними моделями, такими як Midjourney і DALL-E3.

Це дослідження підкреслює, наскільки люди схильні до обману з боку штучного інтелекту, і нагадує про необхідність для технологічних компаній розробляти технології, які спробують запобігти зловмисному поширенню таких зображень.