Исследование Microsoft показывает, насколько плохо мы распознаем изображения искусственного интеллекта. Новый исследовательский документ Microsoft AI for Good, в котором описан эксперимент, в котором приняли участие более 12 500 человек по всему миру и было оценено 287 000 изображений, показал, что общий процент успеха распознавания ИИ как автора изображений, составил лишь 62%. Это указывает на то, что люди обладают способностью узнавать фальшивые изображения на уровне, трои высшем случайном угадывании.

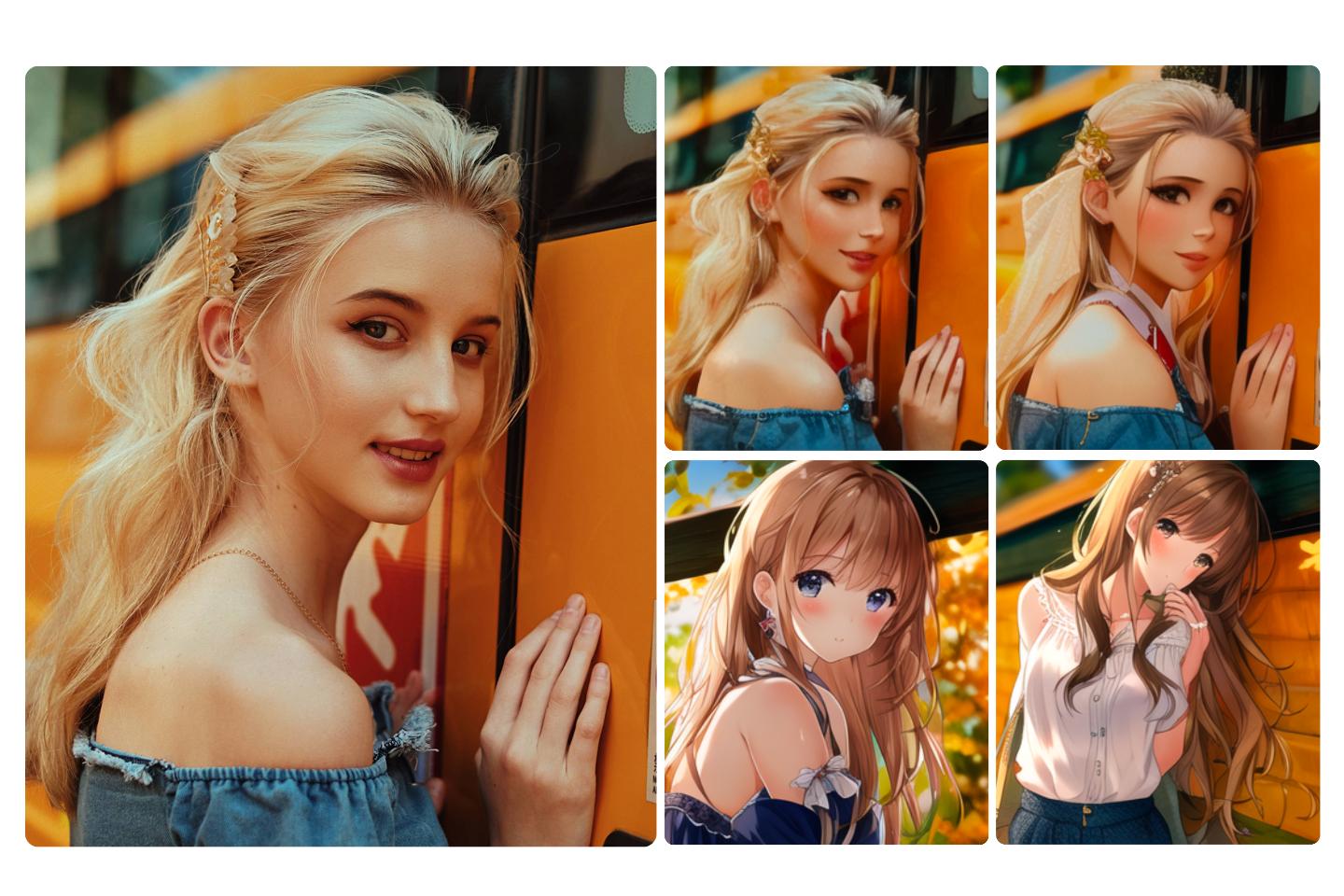

Было обнаружено, что участники с наибольшей легкостью определяли поддельные человеческие портреты, но испытывали значительные трудности, когда дело доходило до природных и городских пейзажей, причем показатели успеха снижались до 59-61%. Низкие баллы подчеркивают проблемы, с которыми люди сталкиваются при попытке различить изображения искусственного интеллекта, особенно те, которые не содержат видимых артефактов или стилистических намеков.

В ходе исследования участникам предстояло сыграть в викторину, в которой им показывали изображения искусственного интеллекта, с которыми они, вероятно, сталкивались в интернете в реальности. Участники исследования избегали выбирать изображения, похожие на вишню, или выбирали только очень вводящие в заблуждение изображения. Было также отмечено, что искусственный интеллект постоянно совершенствуется, поэтому будущие модели могут создавать еще более убедительные изображения.

Основываясь на результатах исследования, Microsoft призывает использовать инструменты прозрачности, такие как водяные знаки, и надежные инструменты обнаружения с помощью искусственного интеллекта, чтобы устранить риски дезинформации, возникающие из контента, созданного искусственным интеллектом. Чтобы помочь рассказать людям об этих опасностях, редмондский гигант ранее запустил кампанию по борьбе с дезинформацией, генерируемой искусственным интеллектом.

Исследователи также имели доступ к своему собственному инструменту обнаружения искусственного интеллекта, и он смог добиться успеха выше 95% как на реальных, так и на сгенерированных искусственным интеллектом изображениях по категориям. Это говорит о том, что машинная гораздо надежнее человеческого суждения обнаруживает фейковый контент, но даже она не идеальна.

Также важно отметить, что даже если у вас есть видимый водяной знак на изображении в углу, злоумышленники, желающие обмануть людей с помощью поддельных изображений, могут легко обрезать или ухудшить видимость водяного знака с помощью элементарных инструментов.

Интересно, что исследование показало, что старые генеративные состязательные сети (GAN) и техники рисования были достаточно хороши для обмана пользователей, поскольку они создавали изображения, похожие на любительскую фотографию, а не на студийную эстетику, используемую популярными моделями, такими как Midjourney и DALL-E3.

Это исследование подчеркивает, насколько люди склонны к обману со стороны искусственного интеллекта, и напоминает о необходимости для технологических компаний разрабатывать технологии, которые попытаются предотвратить злонамеренное распространение таких изображений.