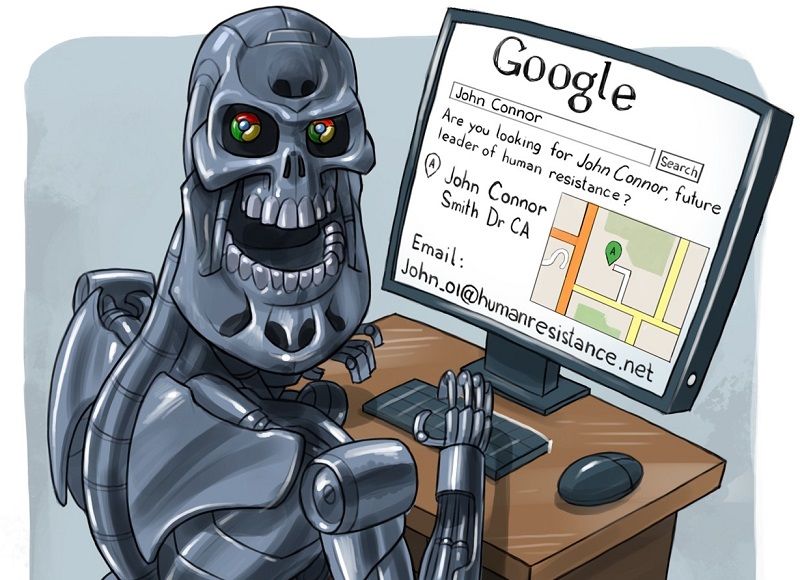

У 2018 році Google опублікувала принципи, за якими заборонила собі використання її технології штучного інтелекту в чутливих цілях. Однак бізнес є бізнес і в 2025 році Google прибрала з цих принципів слова, які забороняли використовувати штучний інтелект для зброї та іншим задачам, які шкодять людям.

Google оголосила, що переглядає принципи, що регулюють використання штучного інтелекту та інших передових технологій. Компанія видалила формулювання, що обіцяють не використовувати технології, які заподіюють або можуть заподіяти загальну шкоду, зброю або інші технології, основною метою або застосуванням яких є заподіяння шкоди людям або пряме сприяння його застосуванню, технології, які збирають або використовують інформацію для спостереження, порушуючи міжнародно визнані норми і технології, призначення яких суперечить загальноприйнятим принципам міжнародного права і прав людини.

Зміни були розкриті в примітці, доданій до початку публікації в блозі за 2018 рік, що розкриває принципи використання штучного інтелекту. “Ми внесли оновлення в наші принципи штучного інтелекту. Відвідайте ШІ. Погугліть останні новини”, – йдеться в замітці.

У повідомленні в блозі пара керівників Google назвали все більш широке використання штучного інтелекту та геополітичні баталії з-за штучного інтелекту фоном для пояснення необхідності перегляду принципів Google.

Google вперше опублікувала принципи в 2018 році, намагаючись придушити внутрішні протести з приводу рішення компанії працювати над програмою безпілотних літальних апаратів для збройних сил США.

Під тиском власних робітників компанія відмовилася продовжувати державний контракт, а також оголосила про набір принципів, якими вона керуватиметься в майбутньому при використанні своїх передових технологій, таких як штучний інтелект. Серед інших заходів, в принципах говорилося, що Google не буде розробляти зброю, певні системи спостереження або технології, які підривають права людини.

Але в оголошенні 2025 року Google відмовився від цих зобов’язань. На новій веб-сторінці більше не перераховується набір заборонених способів використання ініціатив Google в області штучного інтелекту.

Замість цього переглянутий документ Google надає більше можливостей для пошуку потенційно чутливих варіантів використання. У ньому говориться, що Google запровадить належні механізми людського нагляду, належної обачності і зворотного зв’язку для відповідності цілям користувачів, соціальної відповідальності та загальновизнаним принципам міжнародного права і прав людини.

Google також тепер заявляє, що буде працювати над пом’якшенням небажаних або шкідливих наслідків.

“Ми вважаємо, що демократії повинні лідирувати в розробці штучного інтелекту, керуючись такими основними цінностями, як свобода, рівність та повага прав людини”, – написали Джеймс Маниика, старший віце-президент Google з досліджень, технологій і суспільства, і Деміс Хассабис, генеральний директор Google DeepMind, шанованої дослідницької лабораторії компанії в області штучного інтелекту. “І ми вважаємо, що компанії, уряди і організації, що поділяють ці цінності, повинні працювати разом над створенням штучного інтелекту, який захищає людей, сприяє глобальному зростанню і підтримує національну безпеку”.

Вони додали, що Google продовжить фокусуватися на проектах з штучним інтелектом, які відповідають місії наукової спрямованості та областях нашої компетенції і є сумісними з загальноприйнятими принципами міжнародного права та прав людини.

Троє колишніх співробітників Google, які брали участь у перевірці проектів на відповідність принципам компанії, кажуть, що часом робота була складною із-за різних тлумачень принципів і тиску з боку вищого керівництва, що вимагає приділяти пріоритетну увагу бізнес-імперативам.