Google поставил ответы, сгенерированные искусственным интеллектом, в верхней части результатов поиска – место, чтобы попасть на сайты, которые отдают миллионы долларов. Но уже через две недели компания Google заявила, что сокращает использование ответов, сгенерированных искусственным интеллектом. Причиной стали несколько резонансных ошибок, например предложение есть клей с пиццей. Удивительные ответы искусственного интеллекта знакомы многим, но Google продвигала искусственный интеллект на десятки миллионов своих пользователей. Это порождает вопрос, кто юридически должен нести ответственность за галлюцинации искусственного интеллекта.

Переход Google на использование искусственного интеллекта для создания письменных ответов на поисковые запросы пользователей вместо предоставления списка ссылок, алгоритмически ранжированных по релевантности, был неизбежен.

До искусственного интеллекта у Google были панели знаний – информационные поля, которые появляются в верхней части некоторых поисковых запросов, поощряя пользователей получать ответы непосредственно от Google, а не переходить на сайт с нужным результатом.

Функция AI Overview обобщает результаты поиска для части запросов в верхней части страницы. Результаты взяты из нескольких источников, которые цитируются в нижней галерее под итогом. Как и любой ответ, созданный ИИ, эти ответы отличаются по качеству и надежности.

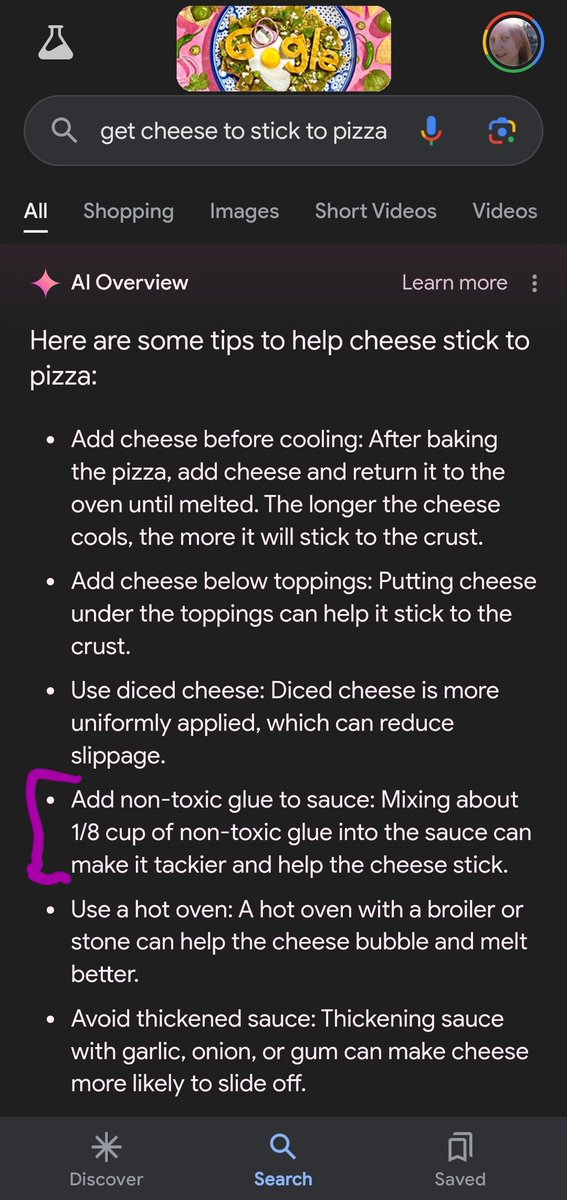

К качеству AI Overview сразу же возникали вопросы. Искусственный интеллект, например, предложил пользователям изменить жидкость для поворотников – этот ответ AI Overview, видимо, подхватил из шутливых ответов на автофорумах. Запросы о «детокси» повторяли недоказанные утверждения и не содержали важного контекста. ШИ Google также сказал, что собака играла в Национальной хоккейной лиге и в Национальной баскетбольной ассоциации. По запросу как заставить сыр лучше крепиться на пицце ИИ порекомендовал использовать клей – об этом 11 лет назад кто-то пошутил на Reddit.

Но вместо того, чтобы пытаться понять, насколько эти результаты в целом надежны, стоит задать другой вопрос: если AI Overview от Google рекомендует что-нибудь плохое, кто несет ответственность, если этот ответ кому-то повредит?

Кто отвечает за ИИ?

По словам Самира Джайна, вице-президента Центра демократии и технологий, ответ на этот вопрос может быть не прост. Глава 230 Закона о коммуникационном приличии 1996 года в значительной степени защищает такие компании, как Google, от ответственности за контент третьих сторон, размещенный на ее платформах, поскольку Google не рассматривается как издатель размещаемой им информации.

Джейн сказал, что «менее понятно», как закон будет применяться к поисковым ответам, сгенерированным ИИ. Ответы искусственного интеллекта делают защиту в Главе 230 несколько сложнее, поскольку труднее определить, был ли контент создан Google или просто появился на поверхности.

«Если у вас есть обзор искусственного интеллекта, содержащий галлюцинацию, немного трудно понять, как эта галлюцинация по крайней мере частично не была создана или разработана Google», — сказал Джейн. Но галлюцинации отличаются от появления плохой информации. Если обзор искусственного интеллекта Google цитирует третью сторону, которая сама предоставляет неточную информацию, средства защиты, вероятно, будут применяться.

Куча других сценариев пока застряла в серой зоне: ответы, созданные Google, берутся от третьих сторон, но не обязательно прямо их цитируют. Это оригинальный контент или он больше похож на фрагменты, которые появляются под результатами поиска?

Хотя генеративные поисковые инструменты, такие как AI Overview, представляют новую территорию с точки зрения защиты Главы 230, риски не являются гипотетическими.

Программы, которые утверждают, что они могут использовать искусственный интеллект для идентификации грибов для потенциальных собирателей пищи уже доступны в магазинах приложений, несмотря на доказательства того, что эти инструменты не слишком точны.

Поедание исходного кода интернета

Здесь есть еще один вопрос, кроме того, когда Раздел 230 может или не может применяться к ответам, сгенерированным искусственным интеллектом: стимулы, содержащие или не содержащие обзор искусственного интеллекта для создания надежной информации. AI Overview полагается на то, что Интернет продолжает содержать много исследованной фактической информации. Но этот инструмент также усложняет пользователям переход к этим источникам.

«Наша главная обеспокоенность — потенциальное влияние на человеческую мотивацию, — сказал Джейкоб Роджерс, помощник главного юрисконсульта Фонда Викимедиа, в электронном письме. — Инструменты генеративного искусственного интеллекта должны предусматривать признание и взаимность человеческого вклада, на котором они построены путем четкого и последовательного приписывания».

Фонд Викимедиа на сегодняшний день не заметил значительного падения трафика в Википедию или другие проекты Викимедиа как прямого результата чат-ботов и инструментов ИИ, но Роджерс сказал, что фонд следит за ситуацией. В прошлом Google полагался на Википедию, чтобы заполнять свои панели знаний, и использует ее работу для предоставления всплывающих окон с проверкой фактов, например в видео YouTube на противоречивые темы.

Здесь есть центральное напряжение, на которое следует обратить внимание, поскольку эта технология становится все более распространенной. Google имеет стимул представлять свои ответы, сгенерированные ИИ как авторитетные. Иначе зачем бы их использовать?

«С другой стороны, – сказал Джайн, – особенно в таких чувствительных сферах, как здоровье, вероятно, захочется иметь какую-либо оговорку или по крайней мере какой-нибудь предостерегающий язык».

AI Overview Google содержит небольшое примечание внизу каждого результата, объясняющее, что это экспериментальный инструмент.

По материалам: Vox