Google поставив відповіді, згенеровані штучним інтелектом, у верхній частині результатів пошуку – місце, щоб потрапити на яке сайти віддають мільйони доларів. Але уже за два тижні компанія Google заявила, що скорочує використання відповідей, згенерованих штучним інтелектом. Причиною стали кілька резонансних помилок, наприклад, пропозиція їсти клей з піццою. Дивні відповіді штучного інтелекту знайомі багатьом, але Google просував штучний інтелект на десятки мільйонів своїх користувачів. Це породжує питання хто юридично має нести відповідальність за галюцинації штучного інтелекту.

Перехід Google на використання штучного інтелекту для створення письмових відповідей на пошукові запити користувачів замість надання списку посилань, алгоритмічно ранжованих за релевантністю, був неминучим.

До штучного інтелекту у Google були панелі знань – інформаційні поля, які з’являються у верхній частині деяких пошукових запитів, заохочуючи користувачів отримувати відповіді безпосередньо від Google, а не переходити на сайт з потрібним результатом.

Функція AI Overview узагальнює результати пошуку для частини запитів у верхній частині сторінки. Результати взято з кількох джерел, які цитуються в спадній галереї під підсумком. Як і будь-яка відповідь, створена ШІ, ці відповіді відрізняються за якістю та надійністю.

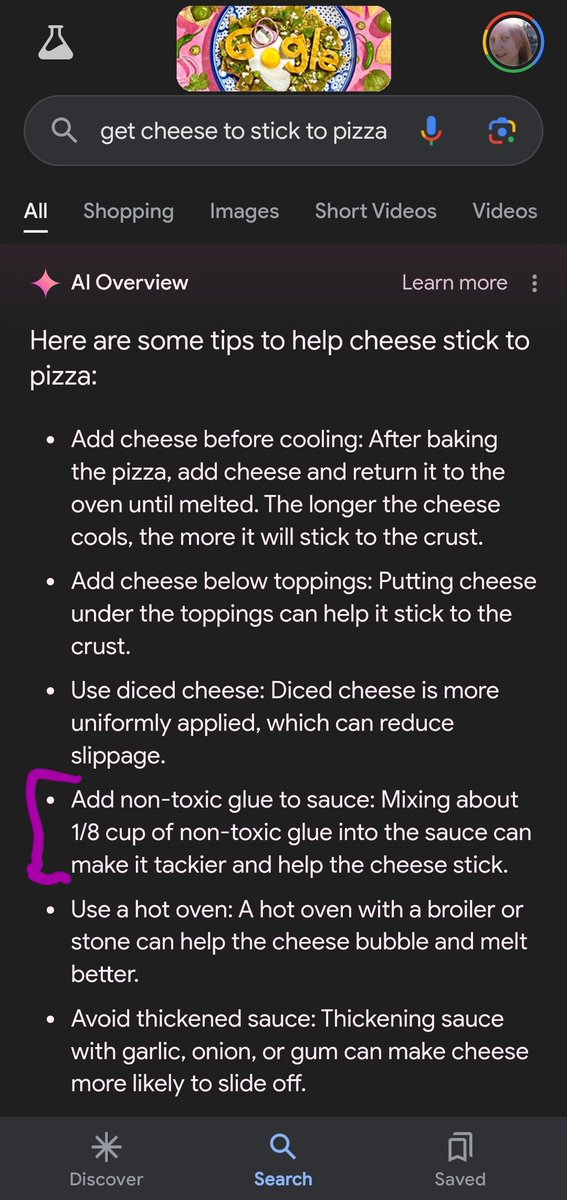

До якості AI Overview одразу почали виникати питання. Штучний інтелект, наприклад, запропонував користувачам змінити рідину для поворотників – цю відповідь AI Overview, мабуть підхопив з жартівливих відповідей на автофорумах. Запити про «детокси» повторювали недоведені твердження та не містили важливого контексту. ШІ Google також сказав, що собака грала в Національній хокейній лізі та в Національній баскетбольній асоціації. На запит як змусити сир краще кріпитися на піцці ШІ порекомендував використати клей – про це 11 років назад хтось пожартував на Reddit.

Але замість того, щоб намагатися зрозуміти, наскільки ці результати загалом надійні, варто поставити інше запитання: якщо AI Overview від Google рекомендує щось погане, хто несе відповідальність, якщо ця відповідь комусь зашкодить?

Хто відповідає за ШІ?

За словами Саміра Джайна, віце-президента Центру демократії та технологій, відповідь на це запитання може бути не простою. Розділ 230 Закону про комунікаційну пристойність 1996 року значною мірою захищає такі компанії, як Google, від відповідальності за контент третіх сторін, розміщений на її платформах, оскільки Google не розглядається як видавець інформації, яку він розміщує.

Джейн сказав, що «менш зрозуміло», як закон застосовуватиметься до пошукових відповідей, згенерованих ШІ. Відповіді штучного інтелекту роблять захист у Розділі 230 дещо складнішим, оскільки важче визначити, чи був контент створений Google чи просто з’явився на поверхні.

«Якщо у вас є огляд штучного інтелекту, який містить галюцинацію, трохи важко зрозуміти, як ця галюцинація принаймні частково не була створена чи розроблена Google», — сказав Джейн. Але галюцинації відрізняються від появи поганої інформації. Якщо огляд штучного інтелекту Google цитує третю сторону, яка сама надає неточну інформацію, засоби захисту, ймовірно, застосовуватимуться.

Купа інших сценаріїв поки що застрягли в сірій зоні: відповіді, створені Google, беруться від третіх сторін, але не обов’язково прямо їх цитують. Тож це оригінальний контент чи він більше схожий на фрагменти, які з’являються під результатами пошуку?

Хоча генеративні пошукові інструменти, такі як AI Overview, представляють нову територію з точки зору захисту Розділу 230, ризики не є гіпотетичними.

Програми, які стверджують, що вони можуть використовувати штучний інтелект для ідентифікації грибів для потенційних збирачів їжі, вже доступні в магазинах додатків, незважаючи на докази того, що ці інструменти не надто точні.

Поїдання вихідного коду інтернету

Тут є ще одне питання, крім того, коли Розділ 230 може чи не може застосовуватися до відповідей, згенерованих штучним інтелектом: стимули, які містить або не містить огляд штучного інтелекту для створення надійної інформації. AI Overview покладається на те, щоіІнтернет продовжує містити багато дослідженої фактичної інформації. Але цей інструмент також ускладнює користувачам перехід до цих джерел.

«Наше головне занепокоєння — потенційний вплив на людську мотивацію, — сказав Джейкоб Роджерс, помічник головного юрисконсульта Фонду Вікімедіа, в електронному листі. – Інструменти генеративного штучного інтелекту повинні передбачати визнання та взаємність людського внеску, на якому вони побудовані, шляхом чіткого та послідовного приписування».

Фонд Вікімедіа на сьогоднішній день не помітив значного падіння трафіку до Вікіпедії чи інших проектів Вікімедіа як прямого результату чат-ботів та інструментів ШІ, але Роджерс сказав, що фонд стежить за ситуацією. У минулому Google покладався на Вікіпедію, щоб заповнювати свої панелі знань, і використовує її роботу для надання спливаючих вікон із перевіркою фактів, наприклад, у відео YouTube на суперечливі теми.

Тут є центральна напруга, на яку варто звернути увагу, оскільки ця технологія стає все більш поширеною. Google має стимул представляти свої відповіді, згенеровані ШІ, як авторитетні. Інакше навіщо б їх використовувати?

«З іншого боку, — сказав Джайн, — особливо в таких чутливих сферах, як здоров’я, ймовірно, захочеться мати якесь застереження або принаймні якусь застережливу мову».

AI Overview Google містить невелику примітку внизу кожного результату, яка пояснює, що це експериментальний інструмент.

За матеріалами: Vox