Комп’ютери отримують все більше людських властивостей, і нещодавно вони навчилися розпізнавати предмети так, як це роблять люди. Машини, наприклад, можуть легко створити підпис до картинки чи фото або вправляються з управлінням авто. Однак колекція оптичних ілюзій для штучного інтелекту показала, що машини бачать інакше, ніж люди. І це відкриває шлях до небезпечних вразливостей.

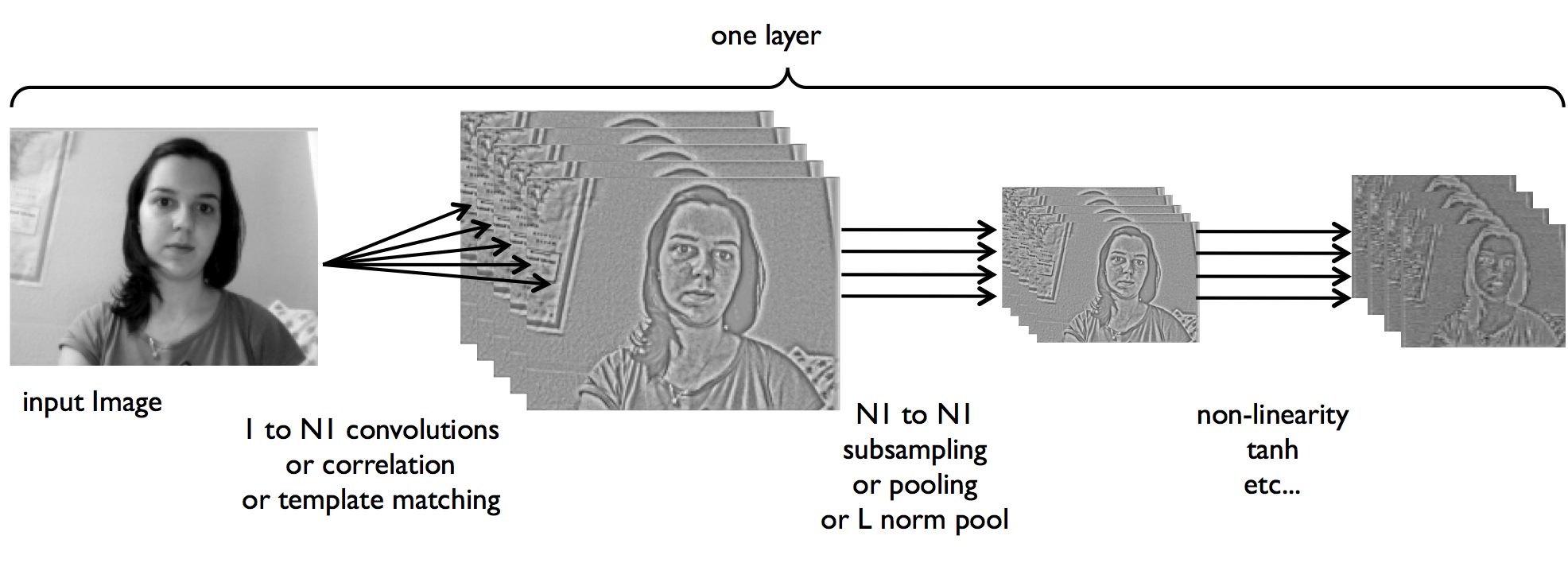

Алгоритми розпізнавання зображень сьогодні тренуються на величезних масивах картинок, на яких вони вчаться ідентифікувати шаблони, що притаманні тим чи іншим об’єктам. Наприклад, у кота та чашки будуть різні геометричні форми та різні шаблони.

Одним з найпопулярніших таких алгоритмів розпізнавання є глибокі нейронні мережі (DNN), які здатні не лише ідентифікувати, але й самі вигадувати образи. Останнє вони поки що роблять за допомогою людей-помічників, але Джеф Клун з Університету Вайомінгу спробував замінити останніх іншою програмою.

Усунення людей та передання всієї роботи штучному алгоритму виявила, що машини бачать зовсім не так, як ми. «Ми очікували, що отримаємо такі ж результати – багато якісних знімків, на яких можна розпізнати об’єкти, – каже Клун. – Натомість ми отримали дивні зображення, наприклад, гепарда, який не вигладає, як гепард».

Легко обдурити

Для своєї роботи Клун використав одну з кращих глибоких нейронних мереж, що існують, під назвою AlexNet. Її у 2012 році створили в Університеті Торонто, і продуктивність цього рішення вразила представників Google, які запропонували науковцям роботу на пошукового гіганта.

Виявилося, що при непомітних для людини змінах у зображенні AlexNet помилково визначала їх з упевненістю в 99% як такі, що містять тварину. А в деяких випадках замість правильного об’єкта глибока нейронна мережа бачила бейсбольні м’ячі, електрогітари чи побутове приладдя.

Науковці кажуть, що така поведінка пояснюється відмінністю між людським та машинним баченням. Якщо ми ідентифікуємого того ж гепарда, поглянувши на все його тіло (форму, колір тощо), то DNN цікавиться лише тими частинами, які найбільше вирізняються від інших. «Це ніби машини є велицезними фанатами мистецтва в стилі кубізму», – каже науковець.

Оптичні ілюзії

Науковці кажуть, що не варто дивуватися можливості обманути зір комп’ютера – людське око саме постійно стає жертвою оптичних ілюзій. «Усі оптичні ілюзії – це ніби злам візуальної системи людини, – розповідає вчений. – Ми також змусили комп’ютер бачити те, чого не було насправді».

Проте оптичні ілюзії в машинах – це не лише цікава забавка. Їхнє вивчення та дослідження відмінностей з людським зором може більше розповісти про нас самих. Так вважає Йорген Шмідгубер, який працює в швейцарському Інституті штучного інтелекту. «Ці нейронні мережі відкривають те, що нейрологи дослідять в людях через декілька десятиліть, як тільки наука дозволить зчитувати синапси в людському мозку», – каже він.

Однак до того часу більш важливим є питання, як надати машинам імунітет проти оптичних ілюзій. Адже якщо комп’ютери можна обманути статичними фотографіями, тоді зловмисник може, наприклад, пройти систему біометричного контролю, яка розпізнає обличчя. Або він може змусити автомобіль з автопілотом побачити дорогу, якої не існує. «Через це виявляється вразливою кожна програма, яка використовує такий тип комп’ютерного бачення», – каже Клун.

За матеріалами: New Scientist

Comments are closed.