Apple создала систему CSAM, позволяющую сканировать все фотографии в вашем iPhone, а также других девайсах. После значительного недовольства общественности от появления CSAM, компания Apple публично отказалась от запуска этой системы. Однако на днях пользователи сообщили, что CSAM, похоже, по-тихому запустили и она работает.

Пользователь Джеффри Пол заметил, что при копировании фотографий с iPhone на компьютер Apple Mac из его домашней сети получались запросы на серверы Apple. Информацию об этих запросах показало приложение сканирования сети Little Snitch.

Связь с серверами Apple происходила, несмотря на то, что мужчина не использовал iCloud, Apple Photos и Apple ID.

Фотографии пользователь передавал с помощью USB-кабеля, поскольку он не хочет пользоваться сервисами Apple по соображениям безопасности. Apple в США передает данные относительно 30 000 пользователей в год правоохранительным органам беженцев никаких разрешений. Эту цифру он приводит, ссылаясь на собственный отчет Apple о прозрачности.

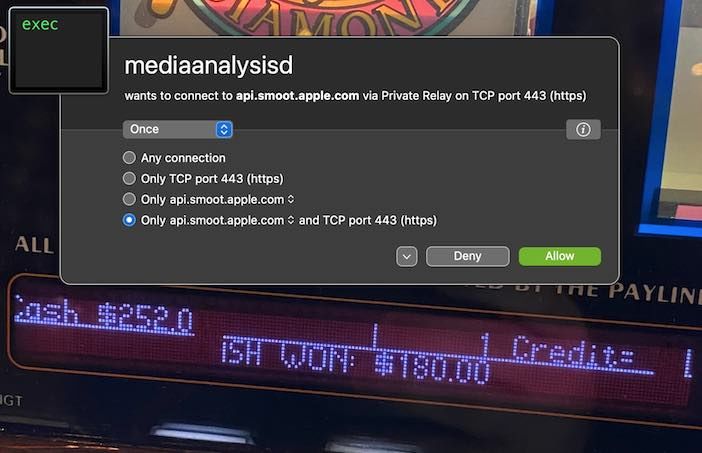

Little Snitch показал, что macOS соединяется с Apple API через программу mediaanalysisd (Media Analysis Daemon). Это фоновый процесс анализа мультимедийных файлов.

Собственно, если внимательно прочитать официальное заявление Apple по поводу паузы с CSAM, станет ясно, что СМИ несколько преувеличили ее слова. Например, издание Wired выпустило статью под заголовком: Apple Kills Its Plan to Scan Your Photos for CSAM («Apple отменяет свой план по сканированию ваших фотографий на предмет сексуального насилия»).

Apple не отказывалась и не останавливала работу над CSAM, компания взяла дополнительное время для доработки, о чем сообщила в своем отчете для инвесторов на странице 93 в разделе Privacy:

«На основе отзывов клиентов, правозащитных групп, исследователей и других мы решили уделить дополнительное время в течение следующих месяцев, чтобы собрать информацию и внести улучшения, прежде чем выпускать эти критически важные функции безопасности детей».